นับเป็นเวลาเกือบ 6 ปีแล้วที่ Apple เลือกใส่เซ็นเซอร์กล้องความละเอียด 12 ล้านพิกเซลไว้กับ iPhone นับตั้งแต่ iPhone 6s และ iPhone 6s Plus ที่เปิดตัวครั้งแรกเมื่อปี 2015 ซึ่งแม้แต่ไอโฟนรุ่นล่าสุดอย่าง iPhone 12 Series ก็ยังคงใช้เซ็นเซอร์กล้องความละเอียด 12 ล้านพิกเซลเช่นเดิม แต่เพราะเหตุใด Apple จึงไม่หันไปใช้เซ็นเซอร์กล้องความละเอียดสูงเหมือนกับสมาร์ทโฟนฝั่ง Android ? ไปหาคำตอบกันครับ

ความละเอียดสูง ไม่ได้หมายถึงความชัด ?

เราต้องทำความเข้าใจกันก่อนว่า ตัวเลขพิกเซลยิ่งสูง ไม่ได้หมายความว่าภาพที่ออกมาจะมีความคมชัดเสมอไป เพราะความเป็นจริงแล้ว จำนวนพิกเซลเป็นตัวบ่งบอกว่าภาพที่ออกมาจะมีขนาดใหญ่มากน้อยเพียงใด ลองนึกภาพง่าย ๆ ว่า เรากับเพื่อนเป็นจิตรกรที่ฝีมือเท่า ๆ กัน กำลังวาดภาพเดียวกัน แต่เราวาดใส่กระดาษ A3 (กล้องที่มีพิกเซลสูง) ส่วนเพื่อนวาดใส่กระดาษ A4 (กล้องที่มีพิกเซลน้อยกว่า) ก็ไม่ได้หมายความว่า รูปที่เราวาดจะมีความคมชัดมากกว่า หรือสวยกว่าภาพของเพื่อนเราแต่อย่างใด เพราะเราวาดใส่กระดาษแผ่นใหญ่กว่าเท่านั้น

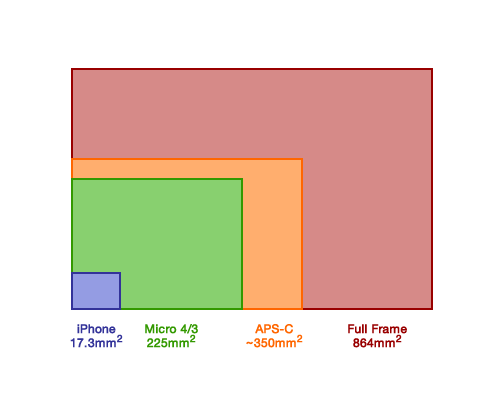

ความละเอียดกล้องไม่ได้ปัจจัยหลักเพียงปัจจัยเดียวที่ทำให้ภาพคมชัด เพราะยังมีในเรื่องของเทคโนโลยีเซ็นเซอร์ เทคโนโลยีประมวลผลภาพ ซอฟท์แวร์การประมวลผลภาพ โครงสร้างชิ้นเลนส์ และขนาดของเซ็นเซอร์ ที่ส่งผลต่อคุณภาพของภาพถ่ายโดยตรง

นอกจากนี้ สมาร์ทโฟนยังมีข้อจำกัดในเรื่องของพื้นที่จัดวางฮาร์ดแวร์ เนื่องด้วยเป็นอุปกรณ์ที่เน้นการพกพา จึงทำให้การใส่เซ็นเซอร์กล้อง และเลนส์ถ่ายภาพขนาดใหญ่ อาจเป็นเรื่องที่ค่อนข้างท้าทายพอสมควร แม้ว่าในปัจจุบันเราจะเริ่มเห็นมือถือที่ใช้เซ็นเซอร์รับภาพขนาด 1 นิ้วบ้างแล้วอย่าง Sharp Aquos R6 หรือ Leica Leitz Phone 1 แต่ก็แลกมาด้วยการจำกัดจำนวนกล้องสำหรับถ่ายภาพเหลือเพียงแค่ 1 ตัวเท่านั้น ซึ่งหมายความว่า เราจะขาดกล้องถ่ายภาพในระยะอื่น ๆ เช่น กล้องมุมกว้าง หรือกล้องซูม ทำให้การใช้งานในสถานการณ์จริงอาจดูไม่สะดวกมากนัก เพราะสมาร์ทโฟนไม่สามารถถอดเปลี่ยนเลนส์ได้เอง อีกทั้ง แม้ว่าจะมีขนาดของเซ็นเซอร์ที่ใหญ่ขึ้นกว่าสมาร์ทโฟนยุคก่อนมาก แต่ก็ยังคงเล็กกว่ากล้องระดับโปรอีกหลายเท่า

และที่สำคัญยิ่งเซ็นเซอร์รับภาพมีความละเอียดสูงมากเท่าใด สมาร์ทโฟนก็จำเป็นต้องใช้พลังในการประมวลผลหนักขึ้นเท่านั้น ซึ่งเป็นเหตุผลว่าทำไมการถ่ายภาพด้วยมือถือกล้องความละเอียดสูงบางครั้ง จึงเกิดอาการค้าง หรือไม่แสดงผลภาพถ่ายทันทีหลังกดชัตเตอร์

หากเราย้อนกลับมาดูที่ iPhone แม้ว่า Apple จะใช้งานเซ็นเซอร์รับภาพความละเอียด 12 ล้านพิกเซลมาโดยตลอด แต่ในความเป็นจริงแล้ว Apple ได้มีการพัฒนาเซ็นเซอร์รับภาพ, โครงสร้างเลนส์ ไปจนถึงระบบซอฟท์แวร์ประมวลผลภาพมาอย่างต่อเนื่อง เพื่อปรับปรุงคุณภาพของภาพถ่าย และทำให้การถ่ายภาพเป็นไปอย่างรวดเร็ว และสะดวก ซึ่งทำให้อาจมีความเป็นไปได้ว่า จริง ๆ แล้ว กล้องความละเอียด 12 ล้านพิกเซลของ iPhone ก็เพียงพอต่อการใช้งานในฐานะกล้องถ่ายภาพมือถือ ที่จำเป็นต้องมีความคล่องตัวสูง บันทึกภาพได้อย่างฉับไว และให้คุณภาพที่เพียงพอต่อการสร้างสรรค์คอนเทนต์เพื่อนำไปแชร์ต่อบนแพลตฟอร์มออนไลน์

นอกจากนี้ หาก Apple ขยับไปใช้กล้องความละเอียดสูงที่ต้องการพลังของโปรเซสเซอร์ที่สูงขึ้น นั่นหมายความว่า อุปกรณ์อื่น ๆ ใน Ecosystem ของ Apple เอง ก็ต้องมีประสิทธิภาพที่สูงขึ้นตามไปด้วย เพื่อรองรับไฟล์ภาพ หรือไฟล์วิดีโอของ iPhone สำหรับทำการปรับแต่ง หรือตัดต่อได้อย่างลื่นไหล เพราะตลอดระยะเวลาที่ผ่านมา Apple เน้นเรื่องการใช้งานแบบไร้รอยต่อ (Seamless) ระหว่างอุปกรณ์ต่าง ๆ ภายใน Ecosystem ของตัวเอง

ซอฟท์แวร์ที่เก่งขึ้น ?

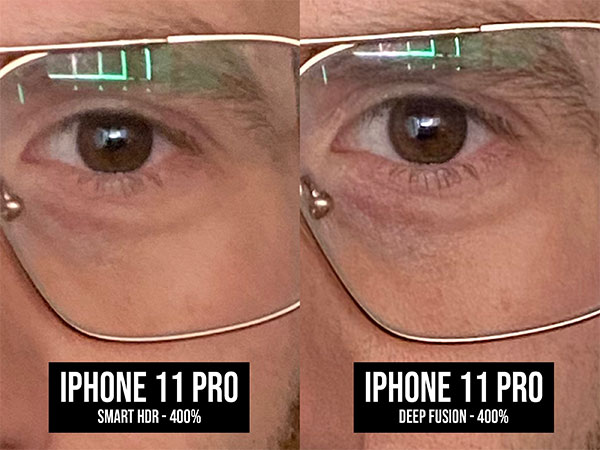

การที่ Apple ยังไม่ตัดสินใจไปใช้เซ็นเซอร์กล้องความละเอียดสูง ส่วนหนึ่งก็อาจเป็นผลมาจากซอฟท์แวร์ประมวลผลภาพของ iPhone ที่เก่งขึ้นในทุก ๆ ปี ซึ่งเราจะเห็นได้จากพัฒนาการของ iPhone Xs / Xs Max ที่ Apple ได้เริ่มนำเอาระบบ Smart HDR มาใช้งานเป็นครั้งแรก โดยจะเป็นการถ่ายภาพหลาย ๆ ใบ ในหลากหลายสภาวะแสงพร้อมกัน เพื่อคัดเลือกภาพที่มีแสง และสีที่ดีที่สุด จากนั้นก็จะนำมารวมกันเป็นภาพถ่ายที่สมบูรณ์เพียงแค่ใบเดียว ทำให้ภาพที่ออกมามีรายละเอียดต่าง ๆ ครบถ้วนมากยิ่งขึ้นนั่นเอง

ต่อมาใน iPhone 11 Series ทาง Apple ก็ได้นำเสนอฟีเจอร์ Deep Fusion ที่จะช่วยให้ถ่ายภาพได้คมชัดมากกว่าเดิม ผ่านการประมวลผลภาพร่วมกับชิปเซ็ต Apple A13 Bionic ที่มี Neural Engine และ Machine Learning เพื่อช่วยประมวลผลภาพลงลึกระดับพิกเซล โดยการถ่ายภาพแต่ละครั้ง ระบบจะทำการถ่ายภาพออกมา 9 ใบเมื่อผู้ใช้ถ่ายภาพในสภาวะแสงน้อย หรือแสงสว่างในระดับกลางๆ จากนั้น ซอฟท์แวร์จะทำการคัดเลือกภาพถ่ายแต่ละใบ และจับภาพที่ดีที่สุดรวมเข้าด้วยกัน ผลลัพธ์จะช่วยให้ภาพถ่ายมีรายละเอียดมากขึ้น และมี Noise ที่น้อยกว่าการถ่ายภาพด้วยโหมดปกติ แถมยังเป็นฟีเจอร์ที่เหนือกว่า Smart HDR ไปอีกขั้น

ใน iPhone 12 Series ก็มีการพัฒนาด้านการถ่ายภาพขึ้นไปอีกระดับ ด้วยการทำงานร่วมกันอย่างล้ำลึกระหว่างชิปเซ็ต Apple A14 และซอฟท์แวร์ประมวลผลภาพอัจฉริยะ ไม่ว่าจะเป็น Smart HDR เวอร์ชัน 3 ที่ถูกอัปเกรดให้ปรับแต่งไฮไลท์ แสงเงา ให้มองเห็นรายละเอียดต่าง ๆ ได้อย่างชัดเจนมากยิ่งขึ้น แถมยังมี Apple ProRAW ที่เป็นการผสมผสานระหว่างการถ่ายภาพในรูปแบบไฟล์ RAW และการประมวลผลภาพถ่ายของ iPhone เพื่อให้ผู้ใช้สามารถนำภาพไปปรับแต่งได้อย่างเต็มที่ ตอบโจทย์ผู้ใช้งานทุกระดับไม่เว้นแต่มือโปร

แนวทางของ Apple ดูค่อนข้างจะคล้ายคลึงกับ Google ที่มือถือ Pixel ก็ไม่ได้เน้นเซ็นเซอร์กล้องหลังความละเอียดสูง แต่เน้นที่การเพิ่มขีดความสามารถของ AI ไปจนถึงซอฟท์แวร์ประมวลผลภาพที่มีประสิทธิภาพ และสามารถทำงานร่วมกับกับกล้องถ่ายภาพที่มีความละเอียดไม่สูงมาก ได้อย่างลื่นไหลโดยไม่กินพลังการประมวลผลของชิปเซ็ตที่มากจนเกินไป

ผลงานที่โชว์ให้เห็นถึงคุณภาพกล้องแล้ว ?

ภาพปกนิตยสาร TIME ที่ถูกถ่ายด้วย iPhone

อีกหนึ่งสิ่งที่อาจทำให้ Apple ยังไม่ตัดสินใจขยับไปใช้กล้องความละเอียดสูง ก็อาจเป็นผลมาจากกล้องความละเอียด 12 ล้านพิกเซลที่ iPhone ใช้อยู่ในทุกวันนี้ ก็เพียงพอต่อการนำไป “ใช้งานจริง” แล้ว

ย้อนกลับไปเมื่อปี 2017 นิตยสารชั้นนำอย่าง TIME ได้นำภาพของอดีตสุภาพสตรีหมายเลขหนึ่งอย่าง Hillary Clinton ขึ้นหน้าปก แต่ความน่าสนใจก็คือ Luisa Dörr ช่างภาพผู้อยู่เบื้องหลังภาพดังกล่าว ไม่ได้ใช้กล้องโปรแต่อย่างใด แต่กลับใช้ iPhone เพียงเครื่องเดียวเท่านั้น แถมยังใช้ iPhone ถ่ายภาพขึ้นหน้าปก TIME มาแล้วกว่า 12 เล่มแล้วดวย

โดยเจ้าตัวให้เหตุผลว่า iPhone มีจุดเด่นในเรื่องของความเบา และอิสระด้านการใช้งาน ไม่จำเป็นต้องมีอุปกรณ์พ่วงต่อให้วุ่นวาย อีกทั้งการถ่ายภาพบุคคลที่ทรงอิทธิพล ก็ต้องการความไวเป็นพิเศษ เพราะตารางงานของพวกเขาค่อนข้างแน่น ทำให้ iPhone กลายเป็นตัวเลือกที่ตอบโจทย์เป็นอย่างมาก

นอกเหนือจากความไว้ใจจากช่างภาพมืออาชีพแล้ว Apple ยังแสดงให้เห็นว่า แม้จะเป็นกล้องความละเอียด 12 ล้านพิกเซล แต่ก็มีประสิทธิภาพเพียงพอที่จะไปโชว์ และใช้ในเชิงโฆษณาได้อย่างสบาย ๆ ซึ่งเราจะเห็นได้จากป้ายโฆษณาบิลบอร์ดของ Apple ตามสถานที่ต่าง ๆ ที่ไม่มีการพูดถึงสเปกมือถือ หรือสเปกกล้อง มีเพียงแค่ภาพถ่าย และข้อความ Shot on iPhone (ถ่ายด้วยไอโฟน) เท่านั้น

อย่างไรก็ดี ปี 2022 อาจเป็นจุดเปลี่ยนของกล้องถ่ายภาพบน iPhone อีกครั้งเหมือนตอนที่ iPhone 6s ปฏิวัติมาใช้กล้อง 12 ล้านพิกเซลเป็นครั้งแรกของค่าย เพราะมีกระแสข่าวลือออกมาว่า iPhone 13 Series อาจปรับไปใช้กล้องถ่ายภาพความละเอียดสูงถึง 48 ล้านพิกเซล ที่มีเทคโนโลยีรวม 4 พิกเซลเล็กเป็น 1 พิกเซลใหญ่ เพื่อช่วยเก็บรายละเอียด และรับแสงได้ดีขึ้น ทำให้ภาพถ่ายในขั้นสุดท้ายจะมีความละเอียดอยู่ที่ 12 ล้านพิกเซล พร้อมรองรับการถ่ายวิดีโอความละเอียดระดับ 8K แต่ข้อมูลด้านต้นจะเป็นจริงแค่ไหนนั้น ก็คงต้องจับตามองกันไปยาว ๆ ครับ

ข้อมูลอ้างอิง : TIME, Apple (1), (2), petapixel, Reddit, Android Authority, ADWEEK

นำเสนอบทความโดย : thaimobilecenter.com

วันที่ : 18/6/2564

ทำไม iPhone ถึงใช้กล้อง 12MP มานานเกือบ 6 ปี ทั้ง ๆ ที่มือถือมีกล้องระดับ 108MP แล้ว - thaimobilecenter

Read More

No comments:

Post a Comment